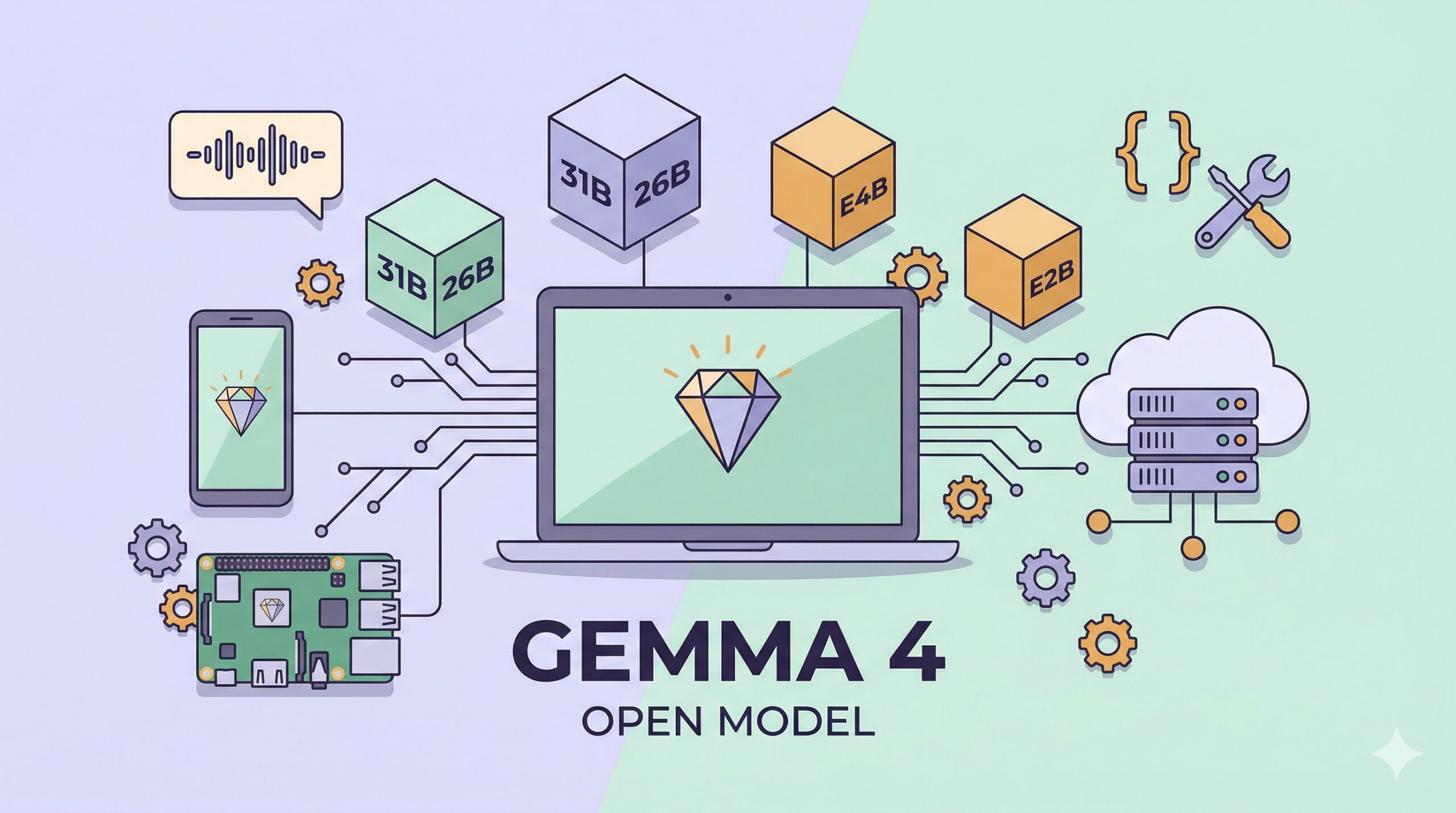

開源 AI 模型的競爭越來越激烈,Meta 的 Llama、阿里的 Qwen、Mistral 各家都在搶地盤。2026 年 4 月 2 日,Google DeepMind 丟出了 Gemma 4——一個從 Gemini 3 研究成果衍生出來的開源模型家族,而且這次直接用 Apache 2.0 授權,沒有 MAU 上限、沒有使用限制,完全開放商用。

Gemma 4 的口號是「byte for byte, the most capable open models」,翻成白話就是:同樣的參數量,沒有人比我強。這不是空口說白話——31B 模型在 Arena AI 文字排行榜拿下開源模型第三名,而 26B MoE 版本只用 3.8B 的有效參數就排到第六。更誇張的是,最小的 E2B 模型只需要 1.5GB 記憶體,就能在手機上離線跑多模態推理。

這篇文章會快速帶大家看 Gemma 4 的模型規格、跑分表現、多模態能力、Agent 功能,以及怎麼在自己的機器上跑起來。

Gemma 4 是什麼

Gemma 是 Google DeepMind 推出的開源模型系列,技術源自他們的旗艦模型 Gemini。上一代 Gemma 3 在 2025 年推出後就獲得不錯的評價,這次 Gemma 4 則是基於 Gemini 3 的研究,在架構和訓練上做了大幅改進。

Gemma 4 一次推出四種尺寸,涵蓋從伺服器到手機的所有場景:

- 31B Dense:完整的 31B 參數密集模型,品質最高,適合需要最強推理能力的場景

- 26B A4B MoE:總共 26B 參數但推理時只啟動 3.8B,用 Mixture of Experts 架構換取極快的推理速度

- E4B:E 是 Effective 的意思,代表推理時實際啟動的有效參數量。E4B 總參數 8B(含 embedding),但有效參數只有 4.5B,邊緣裝置中階選擇

- E2B:同樣以有效參數命名,總參數 5.1B,有效參數 2.3B,最輕量,手機和 IoT 裝置的首選

所有模型都提供 base 和 instruction-tuned(IT)兩種版本,並在 Hugging Face、Kaggle 和 Ollama 上都能下載。

模型規格一覽

| 模型 | 有效參數 | 總參數 | 層數 | Context Window | 支援模態 |

|---|---|---|---|---|---|

| E2B | 2.3B | 5.1B | 35 | 128K | 文字、圖片、語音 |

| E4B | 4.5B | 8B | 42 | 128K | 文字、圖片、語音 |

| 26B A4B MoE | 3.8B(啟動) | 26B | — | 256K | 文字、圖片、影片 |

| 31B Dense | 31B | 31B | 60 | 256K | 文字、圖片、影片 |

幾個值得注意的架構設計:

- Per-Layer Embeddings(PLE):每一層都有獨立的 embedding 注入,等於在主要的 residual stream 旁邊多了一條平行的條件路徑,讓模型能更好地處理多模態輸入

- Shared KV Cache:後面幾層共用前面層的 Key/Value 張量,大幅減少長文推理時的記憶體使用量和計算量

- 混合注意力機制:交替使用 sliding window attention(局部)和 global full-context attention(全域),平衡效率和能力

- 可變圖片 token 預算:可以設定 70 到 1120 個 token 來處理一張圖片,在速度和品質之間自由取捨

跑分表現

先看最直觀的 Arena AI 排名:31B Dense 以 1452 的 Elo 分數排在開源模型第三,26B A4B MoE 以 1441 分排第六——而它推理時只啟動 3.8B 參數。

下面是跟上一代 Gemma 3 27B 的詳細對比:

推理與知識

| Benchmark | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B |

|---|---|---|---|---|---|

| MMLU Pro | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| BigBench Hard | 74.4% | 64.8% | 33.1% | 21.9% | 19.3% |

Gemma 4 31B 在 AIME 2026 數學推理上拿到 89.2%,比 Gemma 3 27B 的 20.8% 高了四倍多。即使是最小的 E2B(2.3B 有效參數),在 GPQA Diamond 上也跟 Gemma 3 27B 打平。

程式碼

| Benchmark | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B |

|---|---|---|---|---|

| LiveCodeBench v6 | 80.0% | 77.1% | 52.0% | 44.0% |

| Codeforces Elo | 2150 | 1718 | 940 | 633 |

視覺理解

| Benchmark | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B |

|---|---|---|---|---|

| MMMU Pro | 76.9% | 73.8% | 52.6% | 44.2% |

| MATH-Vision | 85.6% | 82.4% | 59.5% | 52.4% |

多模態能力

Gemma 4 全系列都支援多模態輸入,但不同尺寸支援的模態略有差異:

- 圖片理解(全部模型):支援可變長寬比和解析度,不需要裁切成正方形。可以做物件偵測、圖片描述、OCR、圖表分析

- 影片理解(31B、26B A4B):多幀分析,支援最長 60 秒的影片

- 語音處理(E2B、E4B):使用 USM 風格的 Conformer 架構,支援語音轉文字和語音問答,最長 30 秒音訊

- 多語言:訓練資料涵蓋 140+ 種語言,post-training 支援 35+ 種語言

有趣的設計是,較大的模型(31B、26B)支援影片但不支援語音,而較小的邊緣模型(E2B、E4B)反而支援語音——這是因為邊緣裝置上的語音互動需求更高。

Agent 能力與 Function Calling

Gemma 4 在 agent 場景下的能力是這次升級的重點之一。模型原生支援:

- Function calling:可以定義工具函式,模型會自動判斷何時需要呼叫,並產生正確格式的呼叫請求

- Structured JSON 輸出:不需要額外的 grammar constraint,模型就能直接輸出結構化的 JSON

- 多步驟推理與規劃:可以把複雜任務拆解成多個步驟,依序執行

- System instructions:原生支援系統指令,方便定義 agent 的行為邊界

- Extended thinking:支援擴展思考模式(最多 4000 tokens),在複雜推理時可以「想久一點」

Google 還推出了 Agent Skills 概念,讓開發者可以在邊緣裝置上建構完全離線的自主工作流——擴充知識庫、產生互動內容、串接其他模型,全部在裝置上完成,不需要網路。

在裝置上跑——真正的邊緣 AI

Gemma 4 最讓人興奮的大概就是邊緣部署能力了。E2B 模型透過 2-bit / 4-bit 量化後,只需要不到 1.5GB 記憶體就能跑,這代表大部分的智慧型手機都能執行——不管是 Android 還是 iPhone。

一些實測數據:

- Raspberry Pi 5 上跑 E2B:prefill 133 tokens/s、decode 7.6 tokens/s

- GPU 加速下,4,000 個 input token 搭配 2 個不同的 agent skill 在 3 秒內完成

- 比上一代快 4 倍、省電 60%

支援的平台涵蓋 Android、iOS、Windows、Linux、macOS(Metal 加速)、WebGPU 瀏覽器、Raspberry Pi,以及 Qualcomm QC8 NPU。硬體方面也獲得 Google、MediaTek、Qualcomm 新一代 AI 加速器的優化支援。

怎麼開始用

Gemma 4 的取得管道很多,以下是幾種常見的方式。

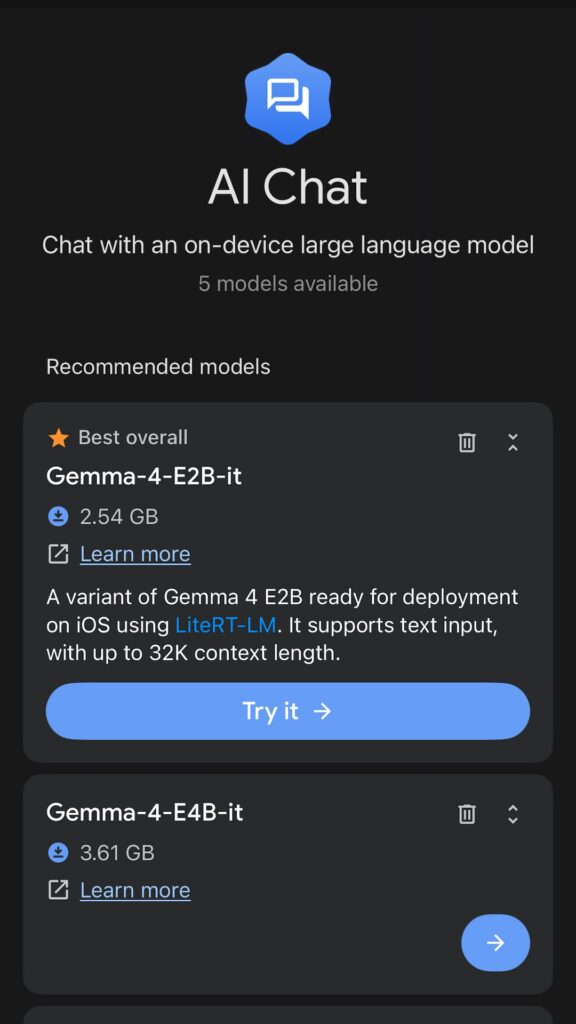

在手機上跑 Gemma 4

想在手機上體驗最簡單的方式是透過 Google AI Edge Gallery app,Android(Google Play)和 iOS(App Store)都有支援,可以直接下載 E2B 或 E4B 模型到手機上離線使用,不需要寫任何程式。

如果是 Android 開發者,還有另一個選擇:AICore Developer Preview。這是 Android 系統級的 on-device AI 服務,開發者可以在 app 中透過 API 呼叫 Gemma 4。更重要的是,E2B 和 E4B 就是未來 Gemini Nano 4 的基礎,現在針對 Gemma 4 寫的程式碼,之後可以直接在搭載 Gemini Nano 4 的裝置上運作,不需要修改。

iPhone 使用者除了 AI Edge Gallery 之外,也可以透過 llama.cpp 的 iOS build 或是支援 Core ML 的工具來部署模型。由於 E2B 只需要 1.5GB 記憶體,近幾年的 iPhone 都有足夠的資源來執行。

Ollama

如果之前沒有在電腦上透過本機跑過模型,可以先參考 Ollama 入門教學 了解基本觀念和安裝。安裝後,一行指令就能跑:

# 跑 E2B(最輕量,適合筆電或手機)

ollama run gemma4:e2b

# 跑 E4B

ollama run gemma4:e4b

# 跑 26B MoE(需要較多記憶體,但推理快)

ollama run gemma4:26b

# 跑 31B Dense(需要大量記憶體,品質最好)

ollama run gemma4:31b更多資訊可以上 Ollama 的網站:https://ollama.com/library/gemma4

llama.cpp

如果想要更細緻的控制,可以用 llama.cpp 搭配 GGUF 量化模型:

# macOS 安裝

brew install llama.cpp

# 啟動 OpenAI 相容的 API server

llama-server -hf ggml-org/gemma-4-E2B-it-GGUF

# 指定量化等級(Q4_K_M 是品質和大小的好平衡點)

llama-server -hf ggml-org/gemma-4-26b-a4b-it-GGUF:Q4_K_MMLX(Apple Silicon)

Mac 使用者可以用 Apple 自家的 MLX 框架,專門針對 M 系列晶片優化:

# 安裝 mlx-vlm

pip install -U mlx-vlm

# 跑多模態推理(圖片 + 文字)

mlx_vlm.generate \

--model google/gemma-4-E4B-it \

--image photo.jpg \

--prompt "描述這張圖片"

# 使用 TurboQuant 節省約 4 倍記憶體

mlx_vlm.generate \

--model mlx-community/gemma-4-26B-A4B-it \

--prompt "解釋量子計算" \

--kv-bits 3.5 \

--kv-quant-scheme turboquantGoogle AI Studio

不想在本機跑的話,31B 和 26B MoE 可以直接在 Google AI Studio 上試用,不需要下載任何東西。E2B 和 E4B 則可以透過 Google AI Edge Gallery 在行動裝置上體驗。

Hugging Face transformers

Python 開發者可以直接用 transformers 載入:

from transformers import pipeline

# 用 pipeline 快速上手

pipe = pipeline("any-to-any", model="google/gemma-4-e2b-it")

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": "photo.jpg"},

{"type": "text", "text": "這張圖片裡有什麼?"}

]

}

]

output = pipe(messages, max_new_tokens=200)

print(output)Apache 2.0——真正的開源

值得特別提一下授權的變化。Gemma 3 當時使用的是 Google 自訂的 Gemma Terms of Use,雖然免費但有一些限制。Gemma 4 直接改用 Apache 2.0 授權,這代表:

- 沒有月活躍使用者(MAU)上限

- 沒有可接受使用政策的額外限制

- 完全的商業使用自由

- 可以自由修改、再發佈

這讓 Gemma 4 在授權上跟 Meta 的 Llama(自訂授權、7 億 MAU 限制)和 Mistral(Apache 2.0)站在同一條線上,甚至比 Llama 更開放。對企業使用者來說,這消除了一個很大的疑慮。

結語

Gemma 4 在開源模型市場裡是一個很有份量的存在。31B 和 26B MoE 在推理能力上直接跟頂級開源模型競爭,E2B 和 E4B 則把多模態 AI 帶到了手機和 IoT 裝置上。再加上 Apache 2.0 授權、原生 agent 能力、140+ 語言支援,開發者們不管是要建 chatbot、做 RAG、跑程式碼生成,還是在 Android app 裡嵌入離線 AI,Gemma 4 都值得認真考慮。

如果還沒在本機跑過開源模型,可以從 Ollama 入門教學 開始,裝好之後一行 ollama run gemma4:e2b 就能體驗了。